随着人工智能技术的飞速发展,传统的冯·诺依曼架构在处理海量数据时逐渐暴露出“内存墙”和“功耗墙”等瓶颈。在这一背景下,存算一体架构作为一种创新的计算范式,正日益被视为推动下一代AI处理器技术发展的关键所在。

一、传统架构的瓶颈与存算一体的兴起

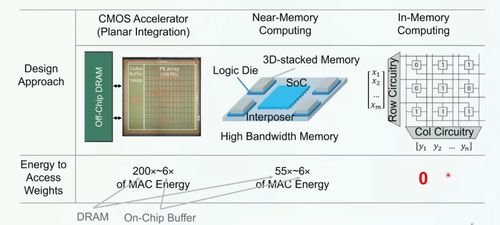

传统计算机系统遵循计算与存储分离的冯·诺依曼架构,数据需要在处理器和存储器之间频繁搬运。这种“搬运”过程不仅消耗大量时间和能量,更在AI应用,尤其是深度学习推理和训练中成为性能的主要制约因素,即所谓的“内存墙”。存算一体架构则从根本上改变了这一模式,它将计算单元嵌入到存储单元内部或与其紧密集成,实现了“在数据存储的位置直接进行计算”,从而大幅减少了数据移动,显著提升了能效比和计算速度。

二、存算一体架构的技术原理与实现路径

存算一体的核心思想是利用存储器件本身的物理特性(如电阻、电荷、相位等)来执行计算操作。主要技术路径包括:

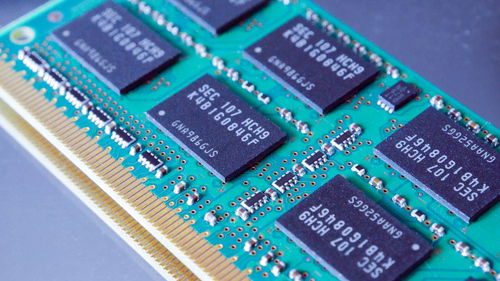

1. 基于新型非易失性存储器:如阻变存储器、相变存储器、磁性存储器等,利用其模拟特性实现矩阵向量乘法等神经网络核心运算。

2. 近存计算:通过先进封装技术(如2.5D/3D集成)将计算逻辑与高带宽存储器(如HBM)极度靠近,缩短互连距离。

3. 内存内计算:对传统DRAM或SRAM电路进行改造,使其具备原位计算能力。

这些技术能够在模拟域或数字域实现高并行度的乘累加运算,完美契合了AI算法,特别是神经网络对大量并行计算和数据处理的需求。

三、对AI处理器发展的关键性影响

存算一体架构为AI处理器带来了革命性的潜力:

- 极致能效:消除不必要的数据搬运,将能量主要用在计算本身,能效比有望提升数个数量级,这对于边缘计算和移动设备至关重要。

- 超高吞吐与低延迟:并行计算能力和数据就地处理特性,极大地提升了计算吞吐量并降低了延迟,可满足实时AI应用的需求。

- 架构创新:促使处理器设计从以计算为中心转向以数据为中心,催生全新的芯片微架构和系统设计方法。

- 软硬件协同新范式:它要求算法、编程模型、编译器乃至操作系统进行相应的适配与优化,从而推动整个软硬件技术栈的协同演进。

四、挑战与未来展望

尽管前景广阔,存算一体架构迈向大规模商业化仍面临挑战:器件精度与一致性、系统级的可靠性与可编程性、与传统生态的兼容性、以及设计工具链的成熟度等都需要持续攻关。

存算一体并非要完全取代传统架构,而更可能是在特定领域(如AI推理、边缘智能)形成优势互补。随着材料科学、半导体工艺和集成技术的进步,存算一体芯片有望率先在物联网、自动驾驶、智能传感等领域实现突破性应用。它不仅是突破现有算力瓶颈的关键技术,更代表了计算架构演进的一个重要方向,将深刻影响未来十年AI处理器乃至整个计算产业的发展轨迹。因此,围绕存算一体的软硬件协同技术开发,无疑是抢占下一代人工智能计算制高点的核心战役。